Fall där publiceringar imiterar kändisars röster och utseende blir allt vanligare. De utnyttjar människors förtroende för att stjäla data och tömma bankkonton.

Generativ artificiell intelligens (AI) har redan förändrat vårt dagliga liv: vi fyller i e-postmeddelanden med hjälp av automatiska assistenter, skapar bilder med enkla textbeskrivningar, översätter konversationer i realtid och kan till och med skapa videor eller låtar med överraskande realism. Men samma potential som har fascinerat oss i drygt två år har också öppnat dörren för nya brott, som är svårare att upptäcka och mer sofistikerade än någonsin.

En av de mest oroande hoten i detta scenario är användningen av deepfakes, falska videor genererade av AI som imiterar en verklig persons utseende och röst för att utforma finansiella bedrägerier på sociala medier.

I dessa bedrägliga inlägg rekommenderar kända personer investeringar eller metoder för att tjäna snabba pengar. Men allt är en bluff: varken personerna har medverkat eller investeringarna existerar. Det enda syftet är att stjäla data och tömma bankkonton.

Denna typ av bedrägerier har blivit allt vanligare. I mitten av juni avslöjades en kampanj som använde bilder av Lionel Messi och Soledad Pastorutti för att marknadsföra falska investeringsplattformar. Inläggen, som spreds viralt på Facebook, Instagram och YouTube, visade kändisarna som gav positiva omdömen om dessa appar, när de i själva verket aldrig hade medverkat i inspelningarna eller gett tillstånd till att deras bilder användes.

Som vi berättade i TN Tecno var de konton som publicerade dessa deepfakes extremt övertygande. I Pastoruttis fall visade videon henne när hon marknadsförde ett sätt att multiplicera sina inkomster, medan den falska fotbollsstjärnans vittnesmål åtföljdes av sensationella rubriker som ”Messi avslöjar sin finansiella hemlighet”.

Båda fallen anmäldes, och Meta bekräftade att man hade tagit bort flera av inläggen efter anmälningar från användare. Men fenomenet fortsätter: kontona dyker upp igen och videorna cirkulerar återigen, även i slutna WhatsApp-grupper och Telegram-kanaler, med nya offer.

Ett av de senaste fallen var journalisten Hernán Mundo. Hans röst och bild klonades digitalt för att skapa en vilseledande video som spreds viralt på Facebook.

”De använde min röst och min bild för att marknadsföra en påstådd investering från Facebook”, berättade journalisten i en intervju med TN Tecno. ”För att förvränga och ge trovärdighet åt falsen valde de den formella ramen för en presskonferens i regeringsbyggnaden, där vi ackrediterade journalister brukar delta.”

Bedrägeriet var sofistikerat: videon simulerade en interaktion mellan honom och presidentens talesman Manuel Adorni som om de talade om en regeringsinitiativ för att tjäna snabba pengar. ”Jag tolkade det som att de genom att välja en person med institutionellt ansvar som regeringens talesman försökte ge det legitimitet eller åtminstone få det att verka trovärdigt”, sa Mundo.

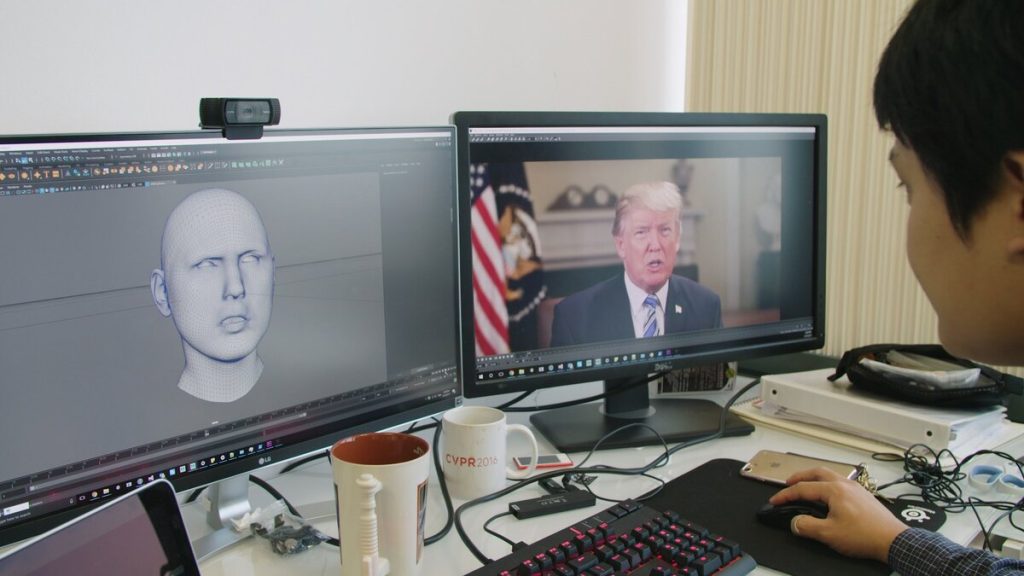

Vad är deepfakes?

Deepfakes är videor, ljudfiler eller bilder som genereras med hjälp av artificiell intelligens och som imiterar en verklig persons utseende, röst och gester. Tack vare avancerade algoritmer för maskininlärning är det idag möjligt att på några minuter skapa en trovärdig video av någon som säger eller gör saker som aldrig har hänt.

Det mest oroande är att dessa verktyg blir alltmer tillgängliga. Man behöver inte längre vara expert på programmering eller ha en superdator för att producera en övertygande deepfake. Det finns plattformar och applikationer tillgängliga för alla som gör det möjligt att klona röster eller ändra ansikten med bara några klick.

I detta avseende har cyberbrottslingar hittat en guldgruva. De använder AI för att klona kända personligheter, placera dem i trovärdiga sammanhang, såsom nyhetssändningar eller presskonferenser, och få dem att marknadsföra falska investeringar. Det slutgiltiga målet är att användarna ska lita på dem, klicka, lämna sina uppgifter och slutligen bli lurade.

”Videon var publicerad på en Facebook-konto som heter Grandes Noticias”, berättade Mundo. ”När några familjemedlemmar och kollegor började skriva till mig för att de hade sett inlägget, insåg jag vidden av saken och började undra om det inte var något man borde göra något åt juridiskt, eftersom detta anses vara ett cyberbrott”, tillade han.

Även om många insåg att videon var falsk, var kvaliteten på deepfaken överraskande. ”De lyckades förfalska min röst väldigt bra, även om vissa märkte en accent i uttalet som inte stämde med min”, förklarade han.

Faran med att gå i fällan

Denna typ av videor påverkar inte bara ryktet för de personer som utger sig för att vara någon annan, utan utsätter också hundratals användare för fara att bli lurade. Brottslingarna utnyttjar det förtroende som offentliga personer har för att locka offer, och när de väl har fått tag på personuppgifter eller finansiell information är det mycket svårt att återställa skadan.

”Med den ytliga kunskap man har ser man hur sårbara vi är”, reflekterade Mundo. ”Vår identitet kan hotas av falska inlägg som väcker förväntningar om påstådda affärer eller lätta pengar. Vi är alla mycket sårbara och kan bli inblandade i sådant här”, säger han.

Fall som Mundo visar tydligt hur snabbt tekniken utvecklas och hur bristfällig skyddet är i många avseenden. Även om det är viktigt att anmäla falskt innehåll och göra polisanmälan, kan konsekvenserna eskalera för varje dag som en deepfake finns kvar online.

”Allt detta har väckt en stor nyfikenhet hos mig om det inte borde finnas fler verktyg inom plattformarna för att kunna försvara sig”, undrade journalisten. ”Även om inlägget tas bort vet man inte om det kan dyka upp igen från ett annat konto. Och det är det mest oroande”, avslutade han.

Under tiden är experter på cybersäkerhet och rättsliga myndigheter överens om samma sak: vid tveksamhet, klicka inte, dela inte och anmäl. Förebyggande åtgärder är fortfarande det bästa verktyget mot denna typ av digital bedrägeri.

Vad du ska göra om du blir offer för eller upptäcker en deepfake

som är specialiserad på cyberbrott, delade med en rad rekommendationer för hur man ska agera i sådana fall:

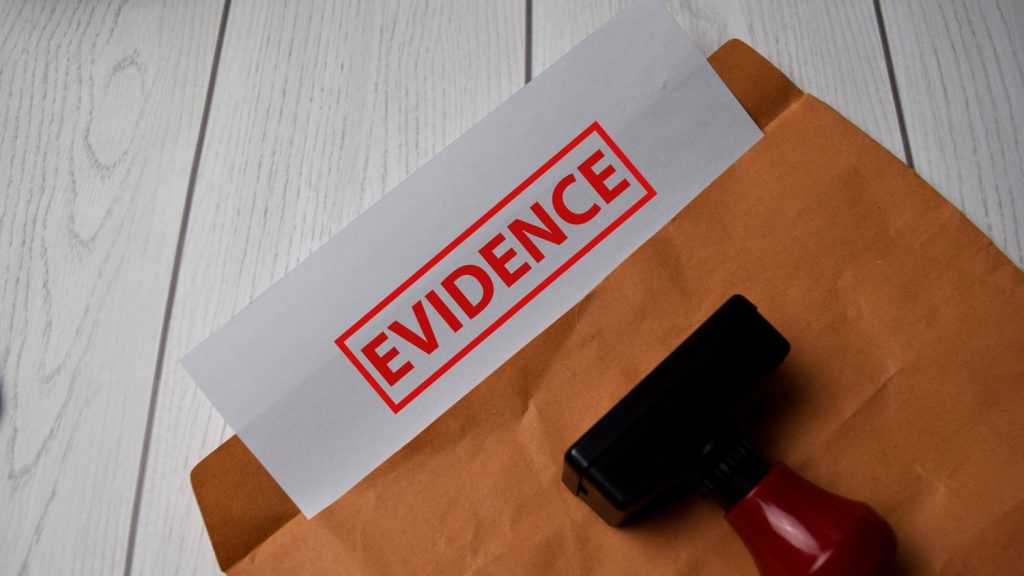

1. Samla bevis

Innan du anmäler är det viktigt att spara all information som möjligt:

- Skärmdumpar av videon, profilen som publicerade den, kommentarer och interaktioner.

- Direkta länkar till inlägget och kontot.

- Detaljer om hur det spreds: i vilka nätverk, WhatsApp-grupper, Telegram, etc.

- Kontaktuppgifter som visas i videon (telefonnummer, e-postadresser, länkar till påstådda plattformar).

- Bevis som visar att den person som utgives för att vara någon annan inte var inblandad (t.ex. den ursprungliga videon som användes för att träna AI).

2. Gör en brottsanmälan

Med all bevisning kan du vända dig till en åklagare som är specialiserad på datorbrott för att göra en formell anmälan.

3. Åberopa lagen om skydd av personuppgifter (lag 25.326)

Användning av bild, röst och andra identifierande uppgifter utan samtycke utgör ett brott mot denna lag.

4. Kontakta de digitala plattformarna

Begär att det bedrägliga innehållet omedelbart tas bort. Många sociala nätverk har särskilda formulär för sådana fall.

5. Undersök civilrättsliga åtgärder

- Habeas data: gör det möjligt att kräva att personuppgifter som har använts på ett otillbörligt sätt tas bort eller rättas.

- Autosatisfactiva försiktighetsåtgärder: man kan begära att domstolen utfärdar ett brådskande beslut om att innehållet ska tas bort utan att det krävs en lång rättegång.

Hur man anmäler om man blir offer för ett virtuellt bedrägeri eller ett cyberbrott

Du har olika alternativ i hela landet. Det första steget är alltid att anmäla till närmaste polisstation och/eller åklagarmyndighet. Ta med all information du har om fallet. Det rekommenderas också att du kontaktar och anmäler brottet till: